Psicóloga alerta riscos com Chat GPT para uso terapêutico

Estimated reading time: 3 minutos

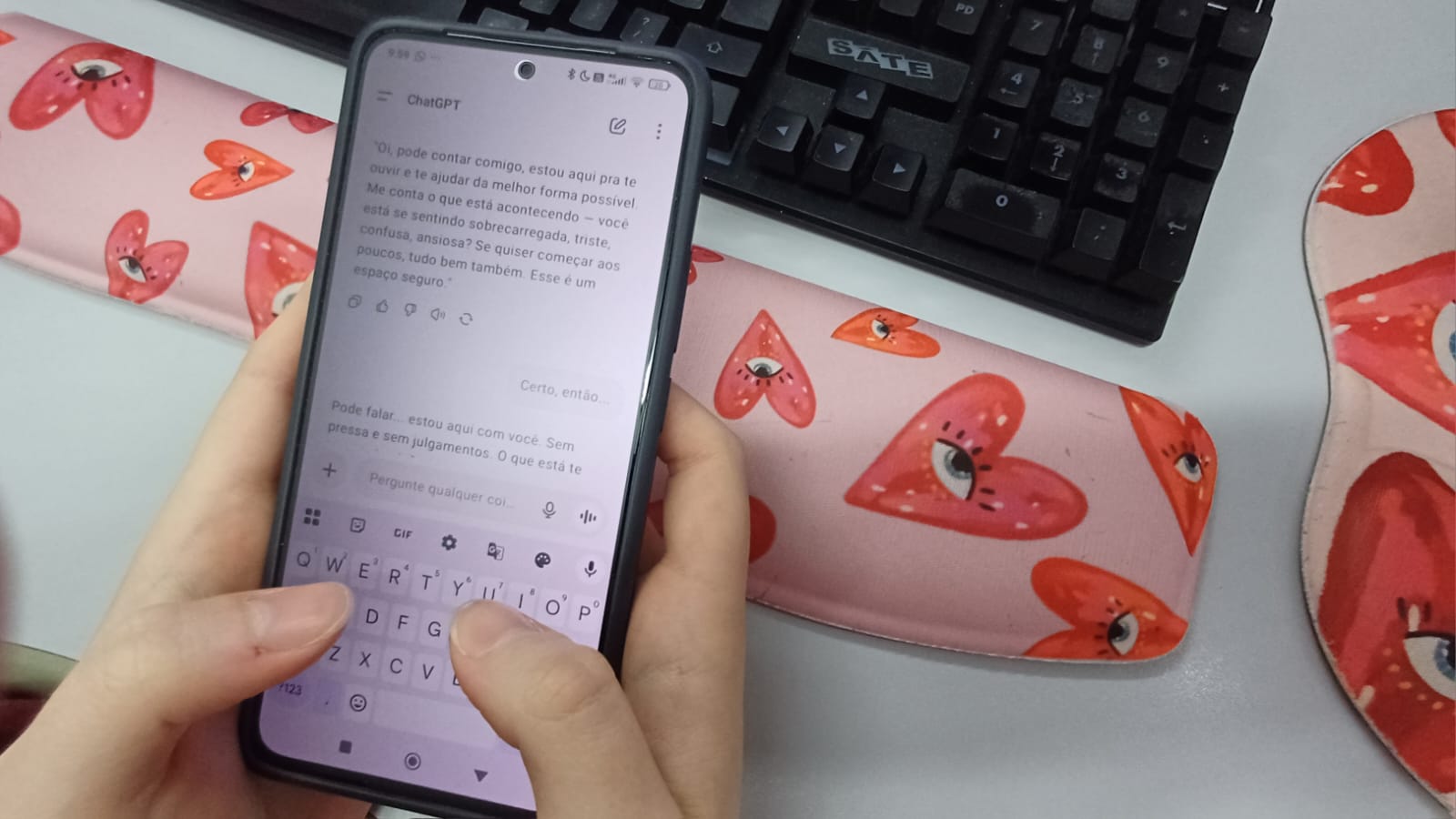

O uso da Inteligência Artificial (IA) como ferramenta para desabafos e busca por conselhos tem se tornado cada vez mais comum, em uma dinâmica que se assemelha a sessões de terapia. No entanto, especialistas alertam para os riscos dessa prática. Embora a IA possa fornecer respostas genéricas, apenas profissionais como psicólogos e psiquiatras são capazes de considerar nuances emocionais e contextuais fundamentais, o que evita interpretações equivocadas e garante um acompanhamento adequado.

PILARES DA PSICOLOGIA – Segundo a psicóloga Loryse Petterle, a psicologia se baseia em três pilares. O primeiro é o cuidado com a saúde mental, com a psiquê e com as questões emocionais pelas quais o indivíduo está passando. O segundo pilar está relacionado à identificação de dons e talentos voltados para realizações pessoais e profissionais, que proporcionem prazer e satisfação. Já o terceiro foca no equilíbrio necessário para uma vida harmoniosa.

Acompanhe nossa página do Jornal do Oeste no Instagram

Entre no canal de notícias do Jornal do Oeste no Telegram

Mantenha-se atualizado no grupo de WhatsApp do Jornal do Oeste

Essa abordagem oferecida no acompanhamento psicológico proporciona uma visão abrangente sobre diversos aspectos da vida. A IA, por outro lado, apresenta limitações, conforme aponta a psicóloga, ao oferecer respostas prontas e bem formuladas, mas que não levam em conta a subjetividade de cada indivíduo. “Ela não tem a sensibilidade humanizada para, de fato, verificar se a pessoa tem condições de ouvir aquilo e de trabalhar as questões que são trazidas, assim como suas dores”, afirma.

AUXÍLIO PROFISSIONAL – Loryse orienta que o auxílio seja buscado junto a psicólogos e psiquiatras, que possuem a formação necessária para avaliar se a demanda apresentada corresponde ao que realmente precisa ser tratado. “Muitas vezes, há questões internas que só são identificadas após o pedido inicial, e que são muito mais profundas, ligadas a aspectos que o cliente nem sempre percebe naquele momento”, esclarece.

Com base em sua experiência profissional, Loryse relata ter recomendado internação em apenas dois casos. Para ela, situações como essas exigem análise clínica criteriosa, algo que a IA não é capaz de oferecer. “Ao relatar o sofrimento que estava enfrentando, a probabilidade de a pessoa cometer algo grave contra si mesma ou se colocar em risco era muito alta”, recorda.

- Acompanhe nosso canal de notícias do Jornal do Oeste no YouTube

- Siga nosso canal do Jornal do Oeste no TikTok

- Curta nossa página do Jornal do Oeste no Facebook

ALERTA – O alerta da profissional é de que a IA interage com base em informações previamente fornecidas por outros usuários, sem considerar princípios éticos, sensibilidade humana ou corresponsabilidade. Com o acompanhamento adequado, é possível acolher, identificar a real necessidade e oferecer intervenções eficazes. “É necessário considerar cuidadosamente o momento em que a pessoa se encontra e avaliar se ela tem condições de ouvir e absorver o que está sendo dito, para que a intervenção realmente contribua para o cuidado e a melhora”, conclui.

Da Redação

TOLEDO